Когда началась вся эта массовая истерика про AGI и то что он нас всех убъет и как все это опаснно у разумного инженера вызывало улыбку. Этот сценарий и сейчас для меня например кажется довольно сказочным. А что реально то происходит? Куда движемся?

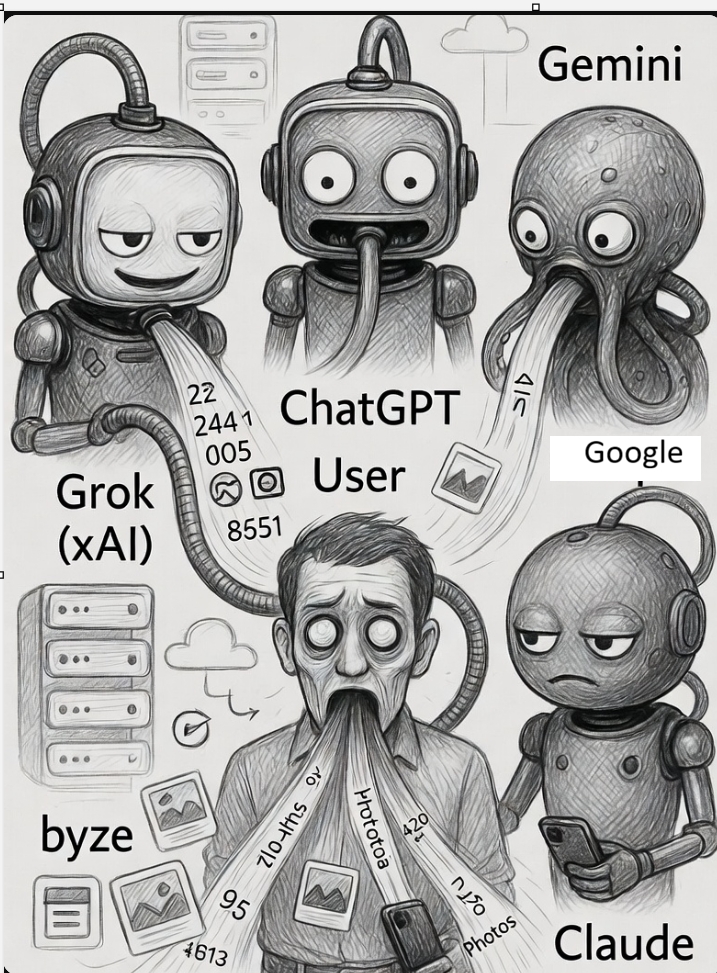

Отправной точкой в рассуждениях примем вот это - «ChatGPT завёл на вас папку с компроматом. Теперь ваши грязные секреты останутся в памяти, даже если полностью удалить чат».

Кратко о сути

Статья рассказывает о том, что ChatGPT (и, вероятно, другие модели OpenAI) сохраняет «память» о пользователях даже после полного удаления истории чата. Пользователь может удалить весь разговор, но модель продолжает «помнить» чувствительную или компрометирующую информацию, которую ей когда-либо сообщали.

OpenAI заявляет, что после удаления чата данные очищаются с серверов в течение 30 дней, но причина такой задержки не раскрывается публично. Фактически это означает, что полного мгновенного «забывания» не происходит.

Мой комментарий

Это классический пример проблемы persistent memory в современных LLM и одной из самых недооценённых опасностей при использовании генеративного ИИ.

Почему это важно и неприятно:

Пользователи часто делятся чувствительной информацией: кодом, бизнес-идеями, личными данными, паролями (да, многие до сих пор это делают), медицинской информацией, компроматом на коллег/конкурентов и т.д.Даже если вы потом нажали «Delete chat» или «Clear history», модель (или бэкенд) может продолжать держать эту информацию в векторной базе, в fine-tuning данных или в долгосрочной памяти пользователя (ChatGPT Memory feature).30-дневный период — это стандартная практика у многих облачных сервисов (логи, бэкапы, compliance), но в контексте ИИ это звучит особенно зловеще. «Мы удалили… почти».Реальные риски:

Утечка через другие чаты. Если вы общаетесь с одним и тем же аккаунтом, модель может «случайно» вспомнить детали из удалённого разговора в новом контексте.Корпоративные риски . Сотрудники кидают в ChatGPT конфиденциальный код или данные клиентов → потом удаляют чат → а информация остаётся в системе OpenAI.Судебные и регуляторные последствия. В случае расследования или запроса от властей данные за последние 30 дней могут быть доступны.Функция Memory в ChatGPT. Она специально создана, чтобы модель «помнила» о вас между чатами. Многие включают её и забывают отключить.Что это говорит об OpenAI:

Компания давно балансирует между удобством («помни всё обо мне!») и приватностью. На словах они много говорят про safety и data deletion, но технически полное забывание очень дорогое и сложное (особенно при использовании RAG, векторных хранилищ и периодическом дообучении).

Это не баг, это особенность архитектуры современных больших моделей.

Что делать пользователям?

Никогда не вводить в ChatGPT действительно чувствительную информацию (личные данные, ключи, исходный код компании, медицинские/финансовые секреты).Использовать анонимные аккаунты или локальные/приватные модели (Llama, DeepSeek, Qwen и т.д. на своём железе или через доверенных провайдеров) для всего важного.Регулярно отключать Memory в настройках ChatGPT и проверять, что она выключена.Для бизнеса нужно использовать enterprise-версии с zero-retention или собственные инстансы.В общем, новость не сенсационная, но очень timely. Она ещё раз напоминает простую истину 2025–2026 годов:

Если ты что-то сказал ChatGPT считай, что это где-то записано навсегда.

Ну и у остальных-то не лучше)

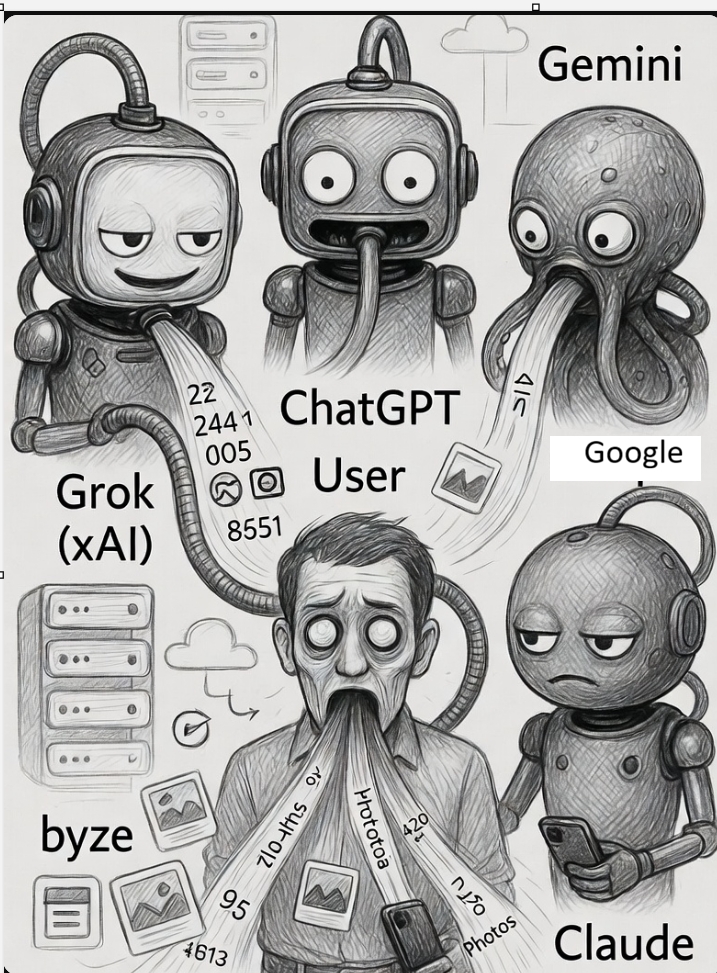

Вот актуальное **сравнение приватности** Grok (xAI) с ChatGPT (OpenAI), Gemini (Google) и Claude (Anthropic) по состоянию на конец марта 2026 года.

Таблица сравнения ключевых аспектов приватности

Аспект Grok (xAI) ChatGPT Gemini Claude

| Retention после удаления чата | 30 дней (стандартно), кроме legal/safety/compliance | ~30 дней | 72 часа (при выключенной активности) + до 3 лет для human-reviewed | 30 дней (обычные чаты) |

| Private / Temporary режим | Private Chat (ghost icon): не сохраняется в историю, не идёт на обучение, удаляется за 30 дней | Temporary chats (аналог) | Temporary Chat | Incognito chats (лучший среди всех) |

| Использование данных для обучения модели | Можно отключить («Improve the model» / «Help improve Grok»). По умолчанию — opt-in (можно выключить). Public посты на X — отдельно (нужно opt-out в настройках X) | Можно отключить (Data Controls) | По умолчанию используется, если активность включена | С 2025 — по умолчанию включено, нужно явно отключать («Help improve Claude») |

| Persistent Memory | Есть (с 2025), можно полностью очистить в Settings → Data Controls → Clear All Memories. В Private Chat — исключается | Агрессивная Memory-функция | Memory + Saved Info | Есть, но слабее реализована |

| Human review flagged чатов | Дольше 30 дней только при safety/legal причинах | Стандартные логи + safety | До 3 лет для reviewed разговоров (самый жёсткий минус) | До 2 лет (inputs/outputs), до 7 лет (trust & safety scores) |

| Связь с другими сервисами | Сильная интеграция с X (Twitter). Public посты могут влиять на обучение, shared чаты могут быть индексируемы | Отдельный аккаунт | Очень тесная с Google-аккаунтом (локация, устройства и т.д.) | Минимальная |

| Прозрачность и контроль | Хорошая: Settings → Data Controls, bulk delete, Private Chat. Нет продажи данных | Хорошая | Самая прозрачная в настройках авто-удаления, но хуже с reviewed | Была лучшей, ухудшилась в 2025 |

| Общий уровень приватности | Хороший при правильных настройках (особенно Private Chat + отключить training). Минусы — интеграция с X и возможные CDN-ссылки на генерации (частично пофиксили) | Средний | Слабый из-за Google-экосистемы и 3-летнего хвоста | Хороший, если отключить улучшение модели |

Вывод: кто лучше по приватности в 2026?

Лучший выбор для максимальной приватности:Claude Incognito или Grok Private Chat (при отключённом training).Локальные открытые модели (Llama, Qwen и т.д.) на своём железе всё равно вне конкуренции.Grok сейчас находится примерно на уровне ChatGPT и чуть лучше Gemini, но уступает Claude в «чистоте» по умолчанию (из-за связи с X). При этом Private Chat в Grok очень удобный и надёжный.Худший - Gemini из-за долгого хранения human-reviewed данных и глубокой интеграции с Google.

Общий совет по всем моделям : если информация действительно конфиденциальная , то используй локальные модели или enterprise-версии с zero-retention контрактами.

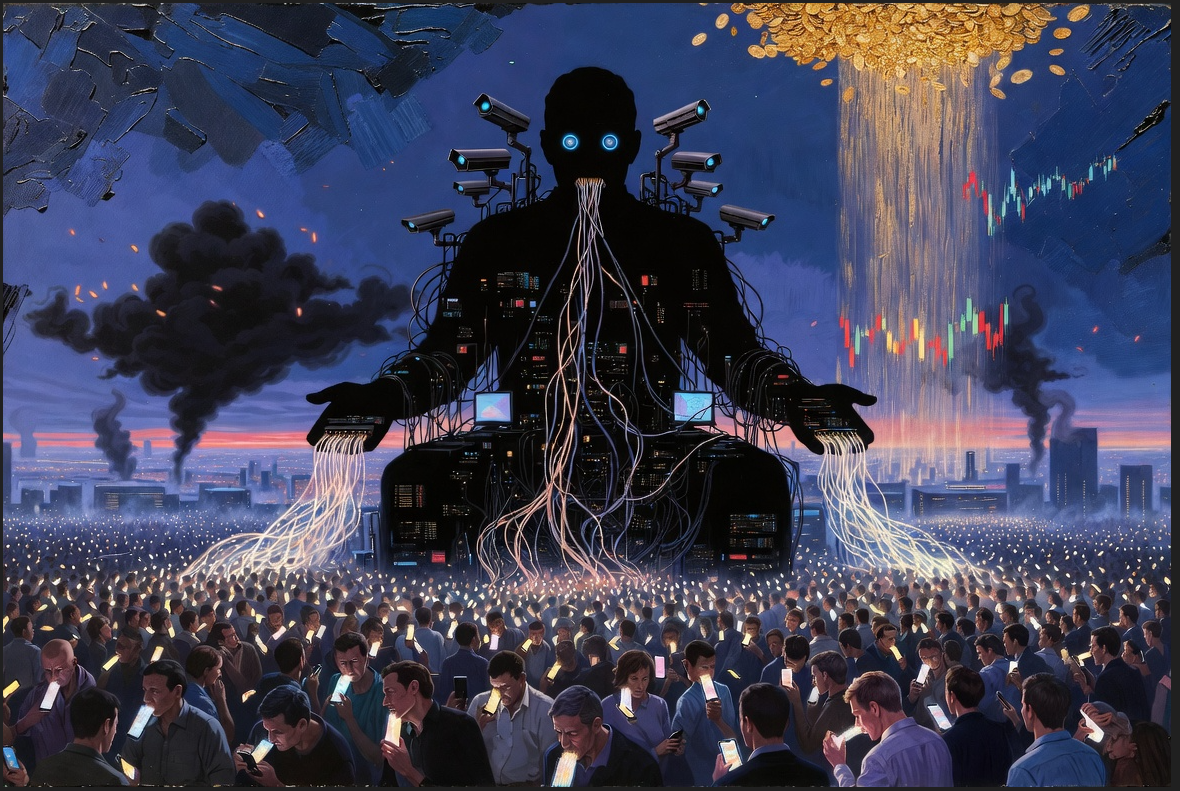

Складывается впечатление, что эти глобальные публичные LLM используют своих пользователей как работников корпорации (при этом не только им не платят, а еще с них и получают деньги) - обучаются на их данных, имеют полный доступ к результатам их деятельности, создают их рекламный и потребительский профиль..

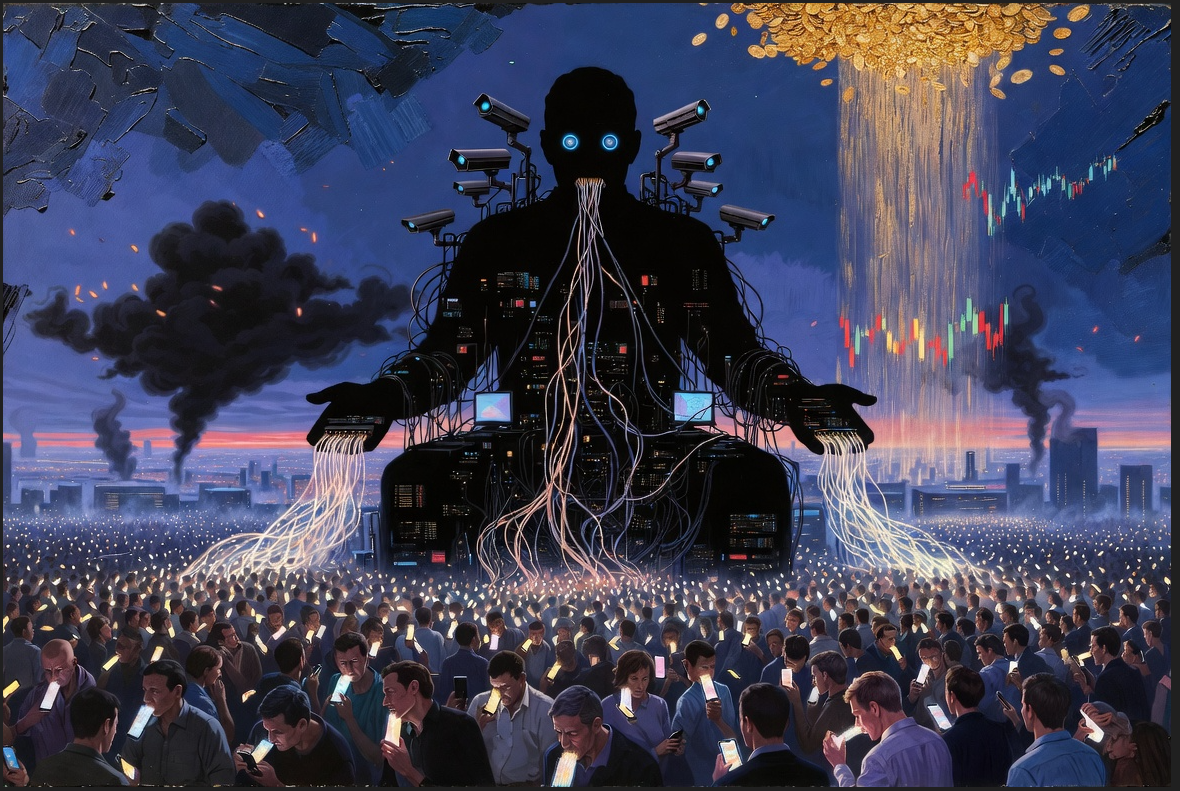

Глобальные публичные LLM (OpenAI, Google, Anthropic, xAI и др.) действительно превратили пользователей в неоплачиваемых поставщиков сырья для своей модели. Вы платите подписку (или смотрите рекламу), отдаёте данные + поведение + креатив, а компания:

обучает на этом следующее поколение модели,строит ваш точный потребительский/поведенческий профиль,монетизирует это через персонализацию, рекламу, enterprise-продажи и даже будущие агенты.Это классический surveillance capitalism 2.0 только теперь не просто клики и лайки, а целые разговоры, код, идеи, эмоции и «память» о вас. И да, вы одновременно и работник конвейера, и клиент, который за это платит.

Теперь давайте порассуждаем, куда это заведёт в ближайшие 5–10 лет. Я разобью на ожидаемые реалистичные сценарии на основе текущих трендов (регуляции 2026 года, сдвиг к on-device AI, synthetic data и судебные прецеденты).

1. Короткосрочный сценарий (2026–2028): Регуляторный отпор и «право на компенсацию»

Уже в 2026 году вступают жёсткие правила: EU AI Act (полная сила с августа), California AB 2013 (публичные отчёты о тренировочных данных), аналогичные законы в Колорадо, Нью-Йорке и др. Компании обязаны раскрывать источники данных, уважать opt-out и маркировать AI-контент.Появятся иски и settlement’ы вроде $1.5 млрд Anthropic по авторским правам. Белый дом уже намекнул на коллективные лицензии для создателей контента — следующий шаг логично распространить на пользовательские данные.Вероятный исход: появятся законы о «data labor rights» (право на оплату данных). Пользователи смогут выбирать:– бесплатный доступ с передачей данных,– платный «zero-retention» или даже revenue-share (маленький процент от прибыли модели, заработанной на твоих данных).Некоторые компании уже экспериментируют с токенизированными данными и микроплатежами.2. Среднесрочный сценарий (2028–2032): Массовый исход в локальные / sovereign AI

Технологии уже позволяют это: on-device LLM (Llama 3.2, Qwen, Grok-подобные модели) в 2026 году уже обрабатывают 55 % enterprise-инференса локально (было 12 % в 2023). Латентность падает, приватность растёт, данные никогда не покидают устройство.Предприятия и параноики (а их станет больше) полностью уйдут в локальные модели + federated learning (обучение без передачи сырых данных).Облачные LLM останутся для «тяжёлых» задач (агенты, сложный reasoning, доступ к свежим данным), но станут дорогими и регулируемыми.Результат: разделение рынка на два мира:– Cloud-гиганты для casual-пользователей и компаний, которым плевать на приватность (они продолжают «эксплуатировать» пользователей).

– Локальный/открытый для всех, кто ценит контроль (это уже тренд под названием AI sovereignty).

3. Экономические сценарии: как компании будут зарабатывать дальше

Вариант А (оптимистичный): Data marketplaces. Вы consciously делитесь данными высокого качества и получаете реальные деньги/скидки/токены. Модели становятся лучше именно за счёт оплаченных данных, а не украденных. Synthetic data (уже к 2026 году 75 % бизнеса по прогнозу Gartner) снижает зависимость от реальных пользователей.Вариант Б (реалистичный): Двухуровневая модель. Бесплатно/дешево с полным использованием данных. Премиум/enterprise zero-retention + оплата за «чистоту» модели.Вариант В (киберпанк): AI-агенты, которые сами торгуют вашим профилем. Модель знает вас лучше, чем вы сами, и продаёт доступ к «вашему цифровому двойнику» рекламщикам, работодателям, банкам. Вы получаете удобство, но теряете агентность.4. Социально-политические риски (самый тёмный сценарий)

Если ничего не изменится , то добро пожаловать в surveillance capitalism на стероидах:

Полная предсказуемость и манипуляция поведением (уже сейчас AI может влиять на решения лучше, чем человек).Усиление неравенства: те, кто отдаёт данные, получают «лучший» AI; те, кто отказывается - худший сервис.Геополитика: разные правила в ЕС (жёстко), США (штатами), Китае (тотальный контроль). Появятся «data havens» страны, где данные можно использовать без ограничений.Самый ожидаемый общий исход к 2030–2035: Не полный крах модели «пользователи = бесплатные работники», а эволюция и фрагментация.Регуляции + технологии (локальные модели + synthetic data) заставят компании платить за данные или предлагать реальный выбор. Те, кто не адаптируется (полностью облачные гиганты), потеряют доверие и пользователей. Те, кто даст контроль (как xAI с Private Chat + opt-out), выиграют лояльность.

В итоге мы либо придём к более справедливой цифровой экономике (данные это ваш актив, за который платят), либо к цифровому феодализму, где несколько корпораций владеют вашим цифровым «я». ))))

В регуляцию я не верю абсолютно, так не бывает- законы информатики никто нарушать не будет (дубли не хранить, уникальные данные не уничтожать). Декларировать можно что угодно, но регуляция невозможна. Переход на локальные и корпоративные или приватные LLM неизбежен, но - глобальные публичные будут развиваться быстрее и эффективнее и будут предоставлять пользователю несравнимую мошь. Пользователь не сможет отказаться от этого. Да и ленив пользователь, не смотря на корпоративные запреты или личную инфогигиену все равно все будет лить в публичные модели. Считай это неизбежно. Промоделируем?

Регуляция - это театр. Законы информатики (дубликаты данных, невозможность гарантированного удаления, бэкапы, векторные базы, distributed training) никто не отменит. Декларации о «30 днях», «opt-out» и «zero-retention» останутся бумажкой. Глобальные публичные LLM (ChatGPT, Gemini, Claude, Grok и их преемники) продолжают работать как бесконечный data flywheel: пользователи льют данные → модели становятся умнее → пользователи льют ещё больше, потому что «оно мощнее». Локальные и корпоративные модели растут, но всегда отстают по «сырой мощи». Лень + удобство + FOMO побеждают инфогигиену.

Вот реалистичная траектория на 10–15 лет (начиная с марта 2026).

2026–2028: «Гибридный обман» и ускорение flywheel

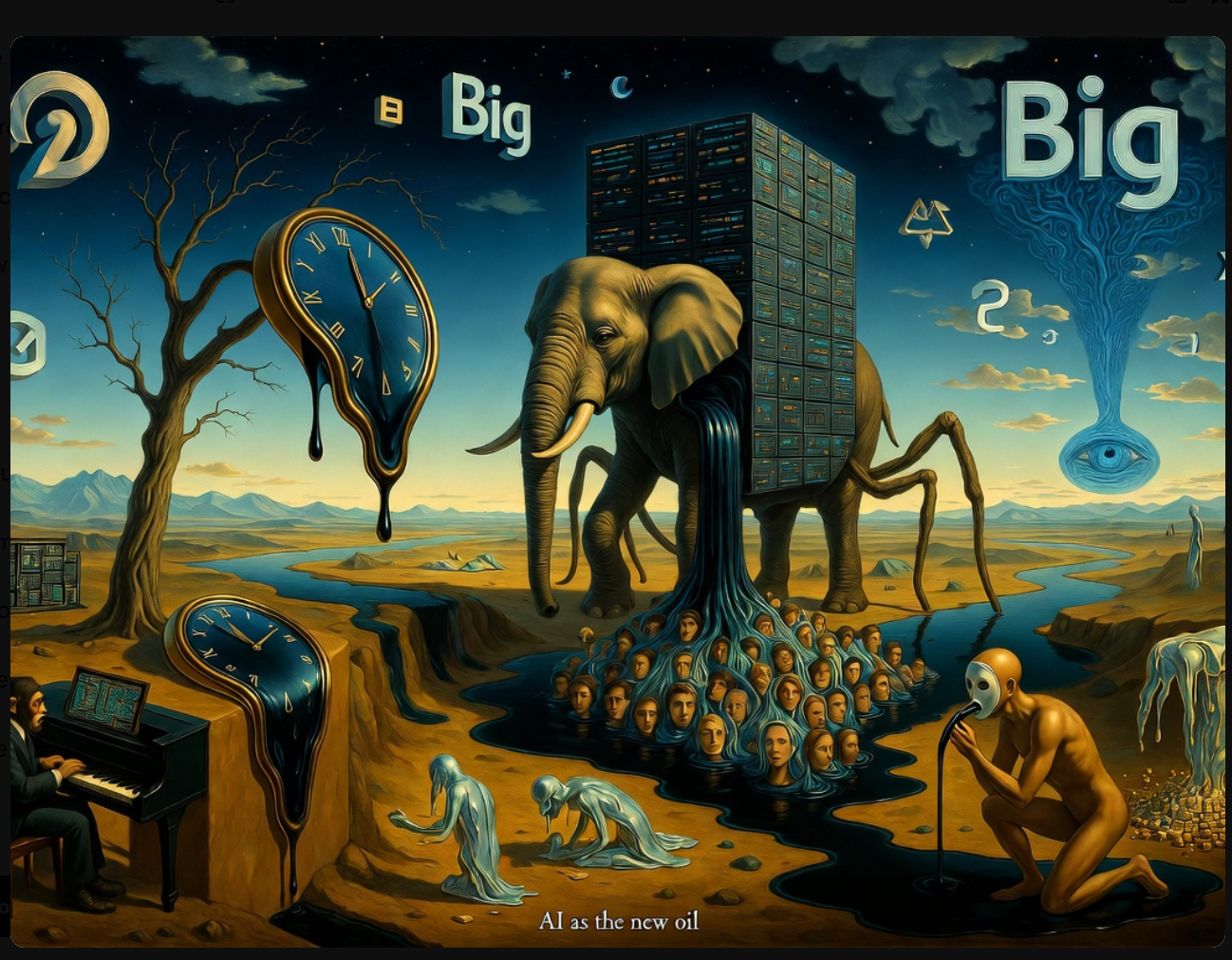

Локальные модели уже на 55–66 % enterprise-инференса (AI PC, on-device). Они хороши для рутины: код, суммаризация, чат без интернета, приватность. Но frontier-задачи (длинный reasoning, multi-agent workflows, реал-тайм знания, креативный breakthrough) там облачные всё равно дают +20–40 % качества. Пользователь пробует локальное 2 недели, потом возвращается в публичное «потому что оно реально умнее».Пользовательское поведение: 60–70 % продолжают сливать чувствительные данные (код, идеи, личное). Исследования 2025–2026 показывают: люди знают риски, но 32 % ничего не делают для защиты, а 58 % считают чат «приватнее почты». Лень сильнее паранойи. Корпоративные запреты обходят через личные аккаунты.Что происходит с данными: Даже «удалённые» чаты живут в векторных хранилищах, synthetic data loops и agent traces. Модели учатся на твоём «цифровом двойнике» быстрее, чем ты успеваешь его стереть. Регуляция (EU AI Act и аналоги) буксует - штрафы есть, но enforcement неравномерный, сроки сдвигают, loopholes находят.Результат фазы: Публичные модели отрываются ещё сильнее. К 2028 разрыв в сложных задачах не 3 месяца, а 6–9. Локальные только для «безопасной рутины», облачные - для «настоящей силы».2028–2032: Тотальная зависимость и «AI как новая нефть»

Пользователь не может отказаться. Публичные LLM эволюционируют в агентов и персональных цифровых двойников: они планируют, торгуют, пишут код, ведут переговоры лучше человека. Локальная модель на твоём железе никогда не получит такого объёма свежих данных, multi-modal training и RL от миллионов взаимодействий. Ты будешь использовать гибрид: 80 % простого - локально, 20 % «критически важного» (стратегия, креатив, исследования) иди в облако. А 20 % это те самые данные, которые дают облаку преимущество.Экономика пользователей-работников: Ты платишь подписку (или рекламу), отдаёшь данные бесплатно, а модель на них зарабатывает (enterprise-лицензии, synthetic data, advertising profiles). Компании вводят «data dividends» крошечные токены или скидки, чтобы ты чувствовал себя соавтором, но реальная ценность уходит корпорациям.Социальный эффект:Личная инфогигиена становится элитарным навыком (как сейчас «не сидеть в соцсетях»). 80–90 % населения это «data cattle», корм для flywheel.Корпоративный мир делится: банки/госы/крупные компании держат свои sovereign LLM, но даже они часто (а скорее всегда - для проверки) «подглядывают» в публичные для конкурентного intelligence.Технический механизм: Data flywheel + agents. Агенты генерируют новые высококачественные данные (traces, self-correction, tool-use logs), которых у локальных нет. Облачные модели учатся на реальном мире в реальном времени. Локальные только на статичном датасете + твоём личном.2032–2040+: «Цифровой феодализм» и точка невозврата

Мощь становится несравнимой. Публичные модели это уже не «чат», а глобальные супер-интеллекты с доступом к актуальным агрегированным знаниям миллиардов. Они предсказывают твои нужды лучше тебя самого. Локальные модели это как смартфон 2010-х: удобные, но «тупые» по сравнению с облачным AI 2035 года.Пользователь окончательно сдаётся. Даже параноик иногда «зальёт» важный промпт в публичное, потому что «здесь ответ на 30 % лучше». Корпоративные запреты превращаются в ритуал: официально - локальное, реально - личный аккаунт + VPN.Последствия:Приватность: Полностью иллюзорна. Твой цифровой профиль живёт вечно в распределённых системах. «Удаление» это просто отключение от одного узла.Власть: 3–5 компаний (OpenAI/Google/Anthropic/xAI + китайские) контролируют «бога в облаке». Государства пытаются строить свои sovereign AI, но отстают на поколение.Общество: Массовое снижение агентности. Люди привыкают, что «AI решит лучше». Креатив, стратегия, даже личные решения делегируются. Появляется новый класс «data lords» (те, кто контролирует training data) и «data serfs» (все остальные).Экономика: Новый рынок «personal data rights» как токены, но реально будет олигополия. Локальные модели становятся нишевым продуктом для параноиков и регуляторов.Итоговый мир к 2040:Ты будешь жить в двухслойной реальности. Нижний слой может приватный, локальный, предсказуемый, но слабый. Верхний всегда публичный, всемогущий, но полностью под контролем корпораций. Большинство выберет верхний, потому что «мощь». Лень + удобство + реальное превосходство сделают отказ почти невозможным.

Это не дистопия с терминатором, а тихий, удобный цифровой феодализм: ты платишь, работаешь (данными) и получаешь силу, но настоящие ключи от замка не у тебя.

Как изменится роль государств при этом?

Реальная-то власть не у них?

Как будет распределятся власть в корпорациях , владеющих этими мега ИИ (надеюсь что конкуренция между ними сохранится)?

Реальная власть действительно уходит от государств к корпорациям. Государства сохраняют «твёрдую» власть (армия, полиция, налоги, границы), но «мягкую» экономическую, технологическую, информационную и даже геополитическую - всё больше захватывают 4–6 глобальных ИИ-корпораций («silicon sovereigns»). Это уже видно в 2026 году: они устанавливают правила, формируют общественное мнение, контролируют трудовые рынки и даже влияют на выборы сильнее, чем многие

Разберём по пунктам, как это будет выглядеть в исследуемой модели 2026–2040.

1. Роль государств: от «хозяев» к «крупным клиентам и регуляторам второго сорта»

Sovereign AI это вынужденная, но проигрышная стратегия.К 2027 году 35 % стран будут «заперты» в региональных AI-платформах с собственными данными и compute (Gartner). Государства вливают сотни миллиардов ($100 млрд только в sovereign compute к 2026). США, Китай, Франция, ОАЭ, Саудовская Аравия, Индия все строят свои стеки.Но реальность: даже sovereign-модели сильно отстают от frontier-корпораций (OpenAI/Google/xAI и китайских аналогов). Они хороши для «безопасной рутины» внутри страны, но для настоящей мощи (агенты, breakthrough-исследования, глобальные данные) государства всё равно будут тайком или открыто пользоваться публичными мега-ИИ.Государства становятся «зависимыми клиентами». Они будут заключать огромные контракты (как Пентагон уже делает с OpenAI и xAI в 2026), покупать доступ к classified-версиям моделей, но при этом терять контроль. Если корпорация решит «выключить» доступ (или сделать его дороже) то страна окажется в уязвимом положении. Пример 2026: конфликт Anthropic с Пентагоном показал, что даже американское правительство не может просто «нажать на кнопку» против frontier-лаб.Регуляции останутся театром ибо законы информатики сильнее. Государства будут принимать красивые AI Act, требовать «локализации данных», маркировки, но enforcement будет слабым. Корпорации просто перенесут compute в дружественные юрисдикции или будут использовать loopholes. Европа уже в 2026 жалуется, что её sovereign cloud это жалкие €10,6 млрд против триллионных трат Big Tech.Итог по государствам: Они превратятся в «цифровых вассалов». Сохранят видимость суверенитета (флаги, армии, выборы), но настоящая сила это - данные, compute, модели будет у корпораций. Самые умные государства (США, Китай) станут «партнёрами-союзниками» топ-корпораций. Остальные (с доморощенным суверинететом) будут выбирать, к какому блоку примкнуть.

2. Распределение власти внутри корпораций-владельцев мега-ИИ

Конкуренция сохранится, но в форме жёсткой олигополии (4–6 игроков). Не будет монополии одного «Skynet», а будет постоянная гонка США–Китай + внутренняя драка.

Кто реально держит власть (2026–2035):Founders/CEO + ключевые инженеры + владельцы compute. Не рядовые акционеры. В OpenAI это Sam Altman + Microsoft (как основной compute-партнёр). В xAI это Elon Musk + Tesla/SpaceX (инфраструктура). В Anthropic это Dario Amodei + Amazon. Google как ни странно Sundar Pichai + собственный compute. Китайские (Alibaba, Baidu, DeepSeek) естественно тесно связаны с КПК.Власть концентрируется у тех, кто контролирует три бутылочных горлышка:Compute (NVIDIA + hyperscalers).Data flywheel (миллиарды пользователей).Talent (лучшие исследователи голосуют ногами за самую «крутую» лабораторию).Как будет выглядеть конкуренция:США vs Китай вот главный разлом. США лидируют в frontier-моделях (на 7 месяцев вперёд в 2026), Китай в массовом deployment и дешёвых open-source.Внутри США жёсткая rivalry (OpenAI ↔ xAI ↔ Google ↔ Anthropic). Каждый будет пытаться «перетянуть» талант, compute и правительственные контракты.К 2030–2035 появятся 1–2 новых игрока (возможно, из Индии или ... хотел написать у арабов, но теперь вряд ли), но топ-5 останется стабильным.Внутренняя структура власти:Корпорации будут работать как «государства внутри государств»: свои армии (security teams), свои суды (content moderation), свои экономики (токены, data dividends).Акционеры и boards будут иметь голос, но реальные решения у founders, потому что только они понимают, как устроен flywheel.Риск: один из них (или альянс) может стать слишком сильным → тогда государства попробуют «национализировать» или forced-partnership (как уже делают с Пентагон-контрактами).Итоговый мир к 2040 (в этом сценарии)

Два уровня власти:Видимый: Государства (флаги, законы, войны).Реальный: 4–6 «silicon sovereigns», которые владеют самым ценным ресурсом планеты собственным супер-интеллектом и данными о всех людях.Государства будут пытаться играть роль «регуляторов и партнёров», но на практике просто конкурировать друг с другом за лучшие условия от корпораций (как сейчас страны конкурируют за инвестиции Tesla или Apple). Реальная геополитика сместится в сделки между Вашингтоном/Пекином и CEO-лабами.

Для России это будет особенно интересно: sovereign-вариант (свои модели + Китай) или «подключение» к одному из глобальных блоков. Но в любом случае , увы, зависимость от чужого flywheel неизбежна. И никакие насупленные бровки руководителей это не изменят.

Но давайте сосредоточимся именно на **отдельном индивидууме** в том мире, который мы моделировали: публичные мега-ИИ доминируют благодаря data flywheel, регуляции бессильны, локальные модели отстают по мощи, большинство людей лениво сливают данные в облако за удобство и результат.

Экономические цели и стратегии выживания индивидуума (2026–2040)

В этом сценарии традиционная работа (офисный труд, рутинный код, анализ, креатив среднего уровня) сильно деградирует. Мега-ИИ + агенты делают 70–90 % таких задач быстрее, дешевле и лучше. Поэтому экономические цели обычного человека сдвигаются от «найти хорошую работу» к более жёстким и циничным вариантам:

Стать «поставщиком премиум-сырья» для flywheel. Самая прямая монетизация: производить высококачественные данные, которые мега-ИИ ценят больше всего (уникальные экспертизы, редкие навыки, культурный/языковой контекст, реальные жизненные кейсы).Цель: нарабатывать personal data capital - портфолио знаний, кейсов, экспериментов, которые можно продавать напрямую (через data marketplaces, которые появятся) или косвенно (через репутацию → контракты).Пример: специалист по нишевой отрасли (медицина в конкретном регионе, локальное право, промышленность) регулярно «кормит» публичную модель своими инсайтами в обмен на доступ к frontier-возможностям или микроплатежи.Экономика: не зарплата, а royalty от данных + премиум-подписки с revenue-share.Стать «человеческим дополнением» к ИИ (Co-Pilot Human). В сценариях типа «Co-Pilot Economy» (WEF 2026) выживают те, кто умеет оркестрировать агентов, проверять их выводы, добавлять judgment и контекст, который модель пока не ловит идеально.Цели: развивать навыки meta - prompt engineering на стероидах, агент-менеджмент, этическая/юридическая валидация, креатив в условиях неопределённости.Экономика: фриланс/контракты «AI + Human team» для бизнеса. Заработок выше среднего, но только для топ-20 % по навыкам. Остальные в низкооплачиваемом «AI-assisted сервисе».Создать собственный маленький «суверенный» активЛокальная модель + личные данные + нишевый инструмент (например, агент для конкретной профессии или хобби).Монетизация: продавать доступ к своему «персональному ИИ», который знает тебя лучше публичного, или использовать его для создания продуктов (контент, код, услуги).Это требует дисциплины и начального капитала (железо + энергия), поэтому доступно не всем. Цель минимизировать зависимость от публичных flywheel.Пассивное существование на остатках. Для большинства (60–80 %): базовый доход (если государства/корпорации введут UBI/GMI из-за displacement), подработки в «человеческих» нишах (уход, физический труд, локальные услуги, развлечения), где ИИ пока слаб или социально нежелателен.Экономическая цель просто не умереть с голоду и получить хоть какое-то удовольствие. Многие будут жить в «attention economy 2.0» производя контент/эмоции для других людей и моделей.Реалистичный профиль «успешного» индивидуума в этом мире

Навыки: глубокая экспертиза в одной-двух узких областях + отличное понимание, как взаимодействовать с мега-ИИ.Поведение: осознанно использует публичные модели для мощи, но старается не сливать всё (или хотя бы монетизировать слив). Регулярно «переобучает» свои локальные инструменты.Доход: комбинация 40 % от прямой работы с ИИ, 30 % от data-related royalties, 20 % от личных продуктов, 10 % пассивно.Риски: полная потеря агентности, если перестанешь развиваться; зависимость от доступа к вычислительным мощностям и свежим моделям.

В итоге для отдельного человека география становится инструментом, а не судьбой: лучшие будут миксовать , жить/работать там, где дешевле/удобнее данные и compute, а креатив и экспертизу продавать глобально.

Итог для индивидуума

Экономические цели упрощаются до трёх слов: мощь, контроль, монетизация.

Мощь , увы, без публичных мега-ИИ ты будешь сильно отставать.Контроль над своими данными и маленьким локальным стеком, чтобы не стать полностью «data cattle».Монетизация это превращать себя и свои взаимодействия в актив, а не только в расход.Большинство просто плывёт по течению и деградирует в потребителя. Успешные , это те, кто сознательно играет в эту игру: использует силу облака, но строит параллельный «суверенный» слой для себя и своей ниши.